Data / IA

Un guide pour se conformer « by design » à l’AI Act

Par La rédaction, publié le 20 janvier 2025

En ce début d’année 2025, les DSI sont invités à déjà mettre en œuvre leur conformité à l’AI Act. D’abord parce que les premières échéances arrivent vite, mais aussi parce que se prémunir contre les risques règlementaires impose une approche « by design » qui ne peut s’appliquer a posteriori. Pour accompagner les entreprises et organisations publiques dans cette approche, le Cigref et Numeum édite en commun un « Guide de mise en œuvre de l’AI Act » à la fois pédagogique, pratique et pragmatique.

Officiellement adopté par les institutions européennes et entré en vigueur le 1ᵉʳ août 2024, le Règlement européen sur l’intelligence artificielle, connu sous le nom d’AI Act, constitue le premier cadre juridique international visant à encadrer le développement, la mise sur le marché et l’utilisation des systèmes d’intelligence artificielle (IA) au sein des États membres.

Son objectif principal est de garantir que les systèmes IA respectent ET respecterons à l’avenir les droits fondamentaux des citoyens européens et qu’ils soient développés et utilisés de manière sûre et éthique.

Petit rappel sur l’AI Act

L’AI Act assure la protection de la vie privée, des données personnelles, et veut prévenir toutes formes de discrimination tout en veillant à ce que les systèmes IA respectent les valeurs démocratiques européennes. Ce cadre règlementaire est basé sur les risques avec l’ambition de classer tout système en quatre catégories de risques :

+ Le Risque inacceptable : systèmes interdits, tels que la notation sociale ou la manipulation comportementale.

+ Le Risque élevé : systèmes soumis à des obligations strictes, notamment ceux utilisés dans les infrastructures critiques, l’éducation, l’emploi ou les services publics essentiels.

+ Le Risque limité : systèmes nécessitant des obligations de transparence, comme les chatbots, où les utilisateurs doivent être informés qu’ils interagissent avec une IA.

+ Le Risque minimal ou nul : systèmes exemptés de restrictions supplémentaires, tels que les filtres anti-spam.

L’AI Act ne se veut ni une interdiction générale de l’IA, ni un remplacement du RGPD (en l’occurrence l’AI le complète), ni un frein à l’innovation (l’AI Act prévoit des “bacs à sable réglementaires” permettant aux entreprises, en particulier les PME, de tester et développer des solutions d’IA dans un environnement contrôlé).

En France, la Commission nationale de l’informatique et des libertés (CNIL) est chargée de veiller à l’application du règlement sur l’IA. Elle a mis en place un plan d’action pour promouvoir une IA respectueuse des droits des personnes et assurer la conformité des entreprises françaises aux nouvelles exigences.

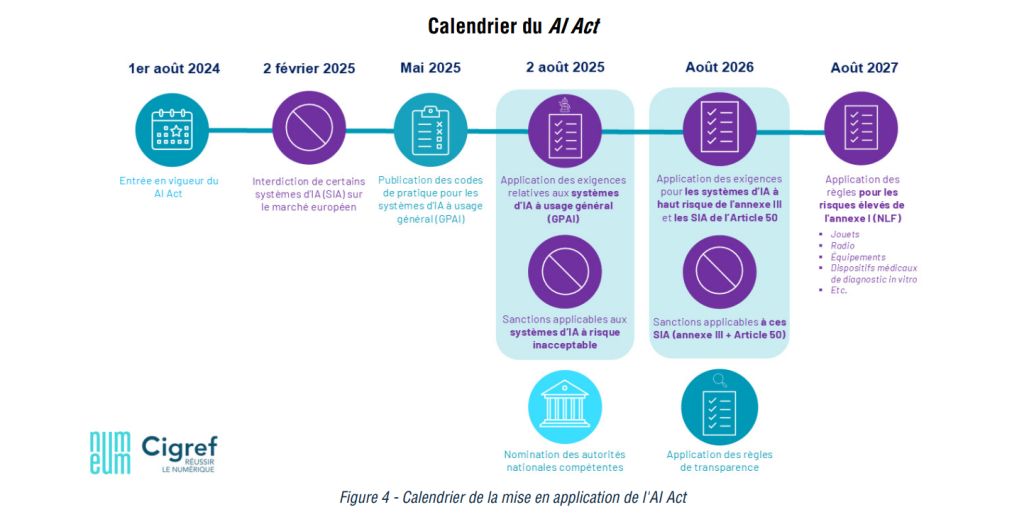

Pour les DSI, l’AI Act doit déjà être une réalité. Car ce règlement est construit pour que ses dispositions puissent être mises en œuvre progressivement et jusqu’en 2026. Dit autrement, même si la France doit encore identifier et publier la liste des autorités compétentes, établir un bac ç sablr règlementaire, définir les règles et sanctions selon la Loi française, les DSI sont invité à d’ores et déj) évaluer leurs projets IA et leurs systèmes IA notamment pour en évaluer les risques et mettre en place les mesures nécessaires pour se conformer aux exigences de l’AI Act.

Un guide en plusieurs volets

Une fois n’est pas coutume Numeum et le Cigref se sont regroupés pour publier en plusieurs épisodes une bible de l’AI Act, un « guide de mise en œuvre de l’AI Act » en plusieurs tomes destiné à accompagner DSI, RSSI, dirigeants, dans l’adoption de le règlement européenne sur l’IA. Optant pour une approche à la fois pédagogique et opérationnelle, il propose une cartographie des obligations réglementaires selon la nature des systèmes IA, leur niveau de risque et le rôle des organisations dans la chaîne de valeur (fournisseurs, déployeurs, mandataires, importateurs ou distributeurs). Il met également à disposition des outils pratiques, des études de cas et des recommandations adaptées.

Le Guide de mise en œuvre répond à trois objectifs majeurs :

1 – Informer et sensibiliser : fournir une vue d’ensemble des obligations légales.

2 – Orienter et conseiller : proposer des stratégies d’intégration des exigences de l’AI Act.

3 – Faciliter la mise en œuvre : offrir des solutions concrètes et des exemples pratiques.

Les deux premiers « livrets » de ce guide ont été publiés la semaine dernière :

* Le premier est une introduction rapide qui reprend les grandes lignes de l’AI Act, déchiffre l’approche européenne, revient sur le calendrier de l’AI Act, la catégorisation des risques, sur la gouvernance et les sanctions. Accessible ici : Guide de mise en œuvre de l’AI Act : Points clés – Introduction – Cigref

* Le second est la première partie du guide qui s’étend en détails sur les obligations. Il s’étend sur la cartographie des obligations applicables aux organisations selon l’AI Act, en fonction de la nature de l’IA, de son niveau de risque, et de la place de l’organisation dans la chaîne de valeur.

Accessible ici : Guide-de-mise-en-oeuvre-de-lAI-Act-1.1-Cartographie-des-obligations

Ces deux premiers volets seront ainsi suivis de deux autres : une dédiée à la « Gouvernance » de cette mise en œuvre de l’AI Act (avec un mode d’emploi pratique et les outils nécessaires) et une dernière partie dédiée aux « Contrats et responsabilité » (avec notamment l’identification des responsabilités et la mise en place des contrats adéquats).

L’initiative mérite d’être saluée d’autant qu’elle démarre cette fois un peu en avance de phase permettant aux entreprises et organisations d’anticiper la trajectoire et de démarrer sans temps de retard. En s’engageant dès aujourd’hui dans une conformité « par design », les entreprises peuvent non seulement se prémunir contre les risques réglementaires, mais aussi renforcer leur crédibilité sur les marchés européens et internationaux.

À LIRE AUSSI :

À LIRE AUSSI :