Data / IA

Pour les DSI, NVidia est la vraie star du CES 2025

Par Laurent Delattre, publié le 09 janvier 2025

Au CES de Las Vegas, cette semaine, NVidia a démontré une nouvelle fois pourquoi la firme était le partenaire incontournable des entreprises sur l’IA… Et ce n’est pas qu’une question de GPU… Loin de là.

Il y a un an, le patron de l’IA chez Meta, le français Yann Le Cun, expliquait : « Il y a une guerre de l’IA, et Nvidia en fournit les armes ». Une vérité qui rappelait que tous les grands centres de R&D en IA avaient besoin des accélérateurs GPU de NVidia et de leur langage CUDA pour animer les méga réseaux de neurones utilisés pour l’apprentissage et l’inférence des grands modèles de langage et autres grands modèles génératifs.

Mais cette vérité est chaque jour encore plus marquée pour les entreprises. Car au-delà des GPU, NVidia a construit bien avant tous les autres acteurs du marché une stratégie à 360° où ses GPU ne sont qu’une simple brique dans un édifice complet et cohérent. Autour des GPU, NVidia a bâti des infrastructures matérielles « DGX » mais surtout une pile logicielle ultra complète, une plateforme cloud-native, gérant (et simplifiant la gestion) de l’intégralité des pipelines IA du développement des modèles IA au déploiement des applications IA. Dénommée « Enterprise AI », cette plateforme est composée de différentes briques comme les microservices NIM (qui transforment les principaux modèles IA du marché en microservices d’inférence optimisés), une pléthore d’outils, l’environnement Omniverse et des frameworks qui simplifient la mise en œuvre de cas d’usage tel que Riva (pipelines conversationnels, avec reconnaissance de la parole, synthèse vocale et traduction automatique), NeMo (plateforme de personnalisation de modèles LLM et VLM) ou Rapids (suite open-source de bibliothèques IA et data-science accélérées par GPU)…

Une plateforme IA omniprésente

Et cette plateforme est devenue au fil des mois totalement incontournable dans l’univers des IA d’entreprise. On en retrouve les briques dans les plateformes IA de Nutanix (GPT-in-a-Box 2), de Dell (Dell AI Factory), de HPE (Private Cloud AI), de VMware (Private AI Foundation), de Red Hat (OpenShift AI), de Pure Storage (GenAI Pod). On en retrouve aussi les briques chez les hyperscalers (AWS, Azure, Google Cloud) ce qui permet notamment de déployer en un clic les applications IA développées « on premises » sur les instances « DGX Cloud ».

Cette omniprésence est bien évidemment un atout fondamental pour les DSI. Elle est une assurance à la fois d’optimisation et de liberté de déploiements.

Et au CES 2025 de Las Vegas, NVidia a encore enfoncé le clou en rattachant toujours plus de cas d’usage d’entreprise à sa plateforme afin d’accélérer et simplifier leur mise en œuvre, rendant de facto la plateforme « NVidia Enterprise AI » encore un peu plus complète et un peu plus incontournable. Nous allons ici revenir sur ces annonces phares.

Des Blueprints pour rapidement déployer des Agents IA

NVIDIA lance des « Blueprints », des modèles de référence, pour créer aisément des agents IA permettant aux entreprises d’automatiser leur travail.

Ces Blueprints permettent aux développeurs de créer des agents IA personnalisés sans gros efforts de développement. Ces agents IA sont capables d’analyser, planifier et agir pour traiter rapidement de grandes quantités de données et extraire des informations pertinentes à partir de vidéos, PDF et autres images.

NVidia a ainsi collaboré avec cinq leaders du domaine de l’orchestration d’Agents IA pour proposer des Blueprints aisément personnalisables : CrewAI (documentation de code), Daily (agent vocal), LangChain (agents d’exploration du Web), LlamaIndex (création de blogs) et Weights & Biases (évaluation et surveillance des interactions IA/humains).

Par ailleurs, NVidia a développé deux autres Blueprints :

Le premier permet de créer automatiquement des Podcasts depuis un fichier PDF !

Le second permet de résumer des vidéos ou de rechercher des informations au sein de vidéos.

Et NVidia a également collaboré avec Accenture autour de son offre « AI Refinery for Industry », pour proposer 12 « Blueprints » de solutions métier pour déployer rapidement des agents IA dans des secteurs variés : automobile, manufacturing, industrie, retail…

Les NVIDIA Blueprints facilitent l’intégration de l’IA pour les développeurs en simplifiant la création et le déploiement d’applications d’IA agentique. Avec les NVIDIA Launchables, les développeurs peuvent rapidement configurer des environnements de développement prédéfinis, rationalisant ainsi le processus de développement. Les entreprises peuvent ensuite déployer ces blueprints sur les diverses plateformes IA de leurs datacenters et sur les principaux clouds.

Un Blueprint « Mega » pour les robots industriels

NVIDIA a également dévoilé “Mega”, un Blueprint pour développer, tester et optimiser des flottes de robots industriels à grande échelle dans un jumeau numérique avant leur déploiement dans des installations réelles.

Mega utilise les API Omniverse Cloud Sensor RTX pour simuler les données des capteurs de manière réaliste, permettant aux robots d’être testés dans un nombre infini de scénarios.

En utilisant Mega, les entreprises peuvent continuellement mettre à jour les “cerveaux” des robots pour améliorer leur efficacité opérationnelle.

Simuler le monde physique et y entraîner les robots de demain

Au-delà des robots industriels, NVidia s’intéresse aussi aux robots humanoïdes qui progressent à grands pas et aux voitures autonomes.

NVidia a ainsi lancé une nouvelle plateforme « Cosmos » et toute une série de modèles spécialisés (les World Foundation Models ou WFMs), optimisés pour ses GPU y compris ses GPU embarqués (comme sa nouvelle puce Thor AGX destinée aux véhicules).

Selon NVidia, les WFMs seront à l’avenir aussi fondamentaux que les LLMs. Ils utilisent des données d’entrée multimodales, notamment du texte, des images, des vidéos et des mouvements, pour générer et simuler des mondes virtuels de manière à modéliser avec précision les relations spatiales des objets dans la scène et leurs interactions physiques.

Ces modèles sont au cœur et sont le cœur de la plateforme NVIDIA Cosmos, conçue pour accélérer le développement de l’IA physique, notamment pour les robots et les véhicules autonomes. Ils ont été entraînés sur plus de 20 millions d’heures de vidéos, afin d’accélérer l’innovation en générant des milliards de kilomètres virtuels et des milliards d’interactions virtuelles pour entraîner les intelligences artificielles qui devront un jour interagir avec le monde physique !

Si les modèles permettent de générer des données de synthèse réalistes, la plateforme en elle-même permet de simuler des environnements afin de permettre d’entraîner des robots et des véhicules à comprendre leur environnement via des mécanismes d’apprentissage par renforcement.

Project Digits : L’IA des datacenters s’invite sur nos bureaux

NVidia, après s’être concentré sur les infrastructures massives, réoriente son attention vers les utilisateurs individuels et les besoins embarqués. Fin 2024, le PDG Jensen Huang avait déjà fait un pas dans cette direction en dévoilant le Jetson Orin Nano Super, un mini-ordinateur IA à 249$ destiné aux bidouilleurs et autres développeurs ayant besoin d’intégrer de l’IA dans des objets connectés. À plus d’un titre, le Jerson Orin Nano Super est un peu le « Raspberry Pi » pour des usages IA.

Au CES 2025, NVidia s’est intéressé aux développeurs d’entreprise qui doivent développer ou réentraîné ou personnalisé à l’extrême des modèles IA.

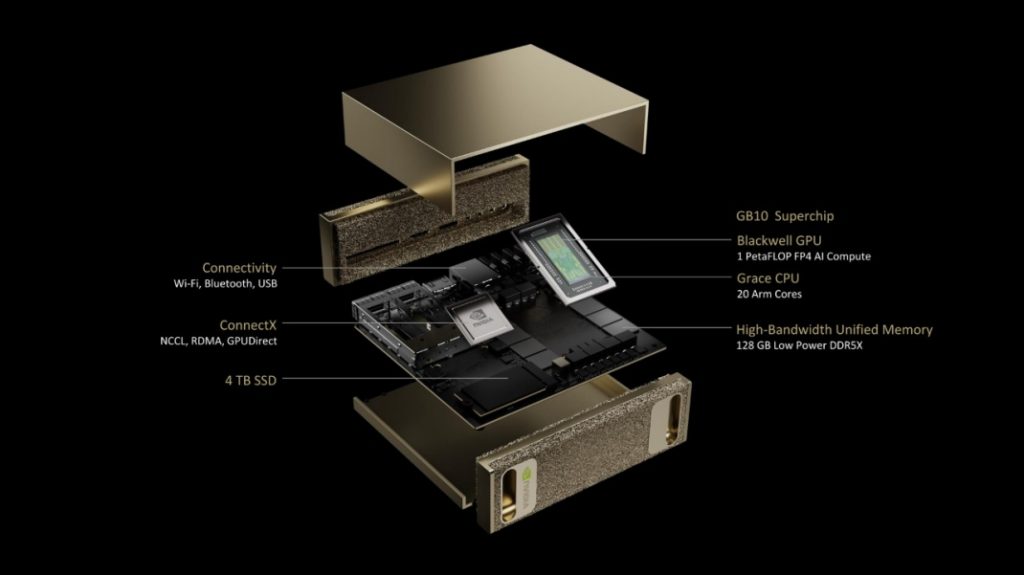

Avec Project Digits, un PC compact mais puissant dédié au développement IA, NVidia veut leur mettre à disposition sur leur bureau un « super calculateur IA » pour travailler en local sur les modèles. Cette machine, commercialisée à 3000$, intègre un processeur Grace-Blackwell GB10 combinant CPU ARM et GPU nouvelle génération, 128 Go de mémoire et 4 To de stockage. Sa particularité ? Elle peut entraîner/inférer en local des modèles jusqu’à 200 milliards de paramètres, extensibles à 405 milliards en couplant deux machines Digits via NVLink.

L’innovation majeure réside dans sa capacité à faire tourner localement des modèles LLM multimodaux sophistiqués comme LLama 3.1 ou Mistral Large 2. Et bien évidemment, cette machine de développement s’accompagne de tout l’écosystème logiciel complet de NVidia (AI Enterprise, NeMo, Rapids) et facilite le déploiement sur DGX Cloud. Disponible dès mai 2025, Project Digits vise à démocratiser le développement IA en proposant aux chercheurs et développeurs une solution abordable, locale, sans compromettre les performances.

En faisant le choix d’une stratégie globale, qui ne se limite pas à la performance brute de ses GPU, NVidia s’est progressivement imposé non pas comme uniquement le partenaire des chercheurs IA mais aussi comme le partenaire clé des entreprises. Au CES 2025, NVidia a démontré toute la cohérence de ses briques matérielles (Blackwell, DGX, Digits, etc.) et logicielles (AI Enterprise, NeMo, Omniverse, Blueprints, etc.) et sa maîtrise de la totalité de la chaîne de valeur de l’IA : depuis le développement et l’entraînement des modèles (sur site ou dans le cloud), jusqu’à l’intégration effective dans des cas d’usage métier — incluant la robotique industrielle, l’automobile autonome et la génération de contenus multimédias. Et chaque nouvelle brique — qu’il s’agisse des Blueprints « Agents IA », de la plateforme de simulation « Cosmos » ou du mini-supercalculateur « Project Digits » — renforce un peu plus l’attrait de son offre « Enterprise AI ». Les DSI disposent ainsi d’un outil unifié capable de répondre à des besoins multiples (traitement conversationnel, génération et synthèse d’images ou de textes, contrôle d’environnements physiques, etc.), et ce avec des déploiements flexibles sur site, en cloud public ou dans des environnements hybrides. La force de l’approche de NVidia qui explique son succès actuel, c’est que la firme américaine n’a jamais perçu l’IA comme un ensemble de modèles ou de GPU, mais plutôt comme un « environnement d’exécution » complet, gérant simultanément infrastructure, orchestration, développement et maintenance.

Pour ceux qui en doutaient, NVidia est désormais bien plus un acteur de l’IA (dans ses dimensions logicielles et matérielles) qu’un simple acteur des GPU.

À LIRE AUSSI :

À LIRE AUSSI :